Ecco la traduzione completa in italiano della lettera aperta firmata dal patron di Tesla e più di 1.000 esperti del settore, pubblicata dal Future of Life Institute, in merito ai problemi etici derivanti dallo sviluppo incontrollato delle intelligenze artificiali

Anche Elon Musk risulta nei più di 1.000 tra ricercatori, manager e esperti del settore che, attraverso una lettera aperta pubblicata dal Future of Life Institute, hanno chiesto uno stop di almeno sei mesi nello sviluppo di sistemi di intelligenza artificiale come ChatGPT, sottolineando le conseguenze preoccupanti al quale questa evoluzione potrebbe portare, definita da alcuni come "scenario Terminator" in riferimento al celeberrimo film di fantascienza con Arnold Schwarzenegger.

Rischi profondi per l'umanità

"I sistemi di IA dotati di un’intelligenza competitiva con quella umana possono comportare rischi profondi per la società e l’umanità, come dimostrato da ricerche approfondite e riconosciuto dai migliori laboratori di IA" si legge nel comunicato. "Come affermato nei principi di Asilomar per l'intelligenza artificiale ampiamente approvati, l’IA avanzata potrebbe rappresentare un cambiamento profondo nella storia della vita sulla Terra e dovrebbe essere pianificata e gestita con cura e risorse adeguate. Sfortunatamente, questo livello di pianificazione e gestione non sta avvenendo, anche se negli ultimi mesi i laboratori di IA si sono impegnati in una corsa fuori controllo per sviluppare e impiegare menti digitali sempre più potenti che nessuno - nemmeno i loro creatori - è in grado di comprendere, prevedere o controllare in modo affidabile".

approfondimento

WGA apre all'uso dell'intelligenza artificiale per le sceneggiature

I pericoli dell'IA

"I sistemi di intelligenza artificiale contemporanei stanno diventando competitivi con gli esseri umani in compiti generali e dobbiamo chiederci se sia il caso di lasciare che le macchine inondino i nostri canali di informazione", si legge ancora nella lettera aperta. "Dobbiamo lasciare che le macchine inondino i nostri canali di informazione con propaganda e falsità? Dovremmo automatizzare tutti i lavori, compresi quelli più soddisfacenti? Dovremmo sviluppare menti non umane che alla fine potrebbero superarci di numero, essere più intelligenti e sostituirci? Dobbiamo rischiare di perdere il controllo della nostra civiltà? Queste decisioni non devono essere delegate a leader tecnologici non eletti. I potenti sistemi di intelligenza artificiale dovrebbero essere sviluppati solo quando saremo sicuri che i loro effetti saranno positivi e i loro rischi gestibili. Questa fiducia deve essere ben giustificata e aumentare con l’entità degli effetti potenziali di un sistema. La recente dichiarazione di OpenAI sull’intelligenza artificiale generale afferma che a un certo punto, potrebbe essere importante ottenere una revisione indipendente prima di iniziare ad addestrare i sistemi futuri, e per gli sforzi più avanzati concordare di limitare il tasso di crescita dei calcoli utilizzati per creare nuovi modelli. Siamo d’accordo. Quel punto è ora, lo abbiamo già raggiunto".

approfondimento

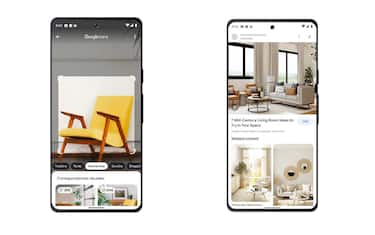

Google: ecco come stiamo migliorando la ricerca e le mappe con l'IA

Sei mesi di stop

Ancora Musk e i firmatari della lettera aperta: "Pertanto, chiediamo a tutti i laboratori di IA di sospendere immediatamente per almeno 6 mesi l’addestramento di sistemi di IA più potenti del GPT-4. Questa pausa deve essere pubblica e verificabile e deve includere tutti gli attori chiave. Se tale pausa non può essere attuata rapidamente, i governi dovrebbero intervenire e istituire una moratoria. I laboratori di IA e gli esperti indipendenti dovrebbero utilizzare questa pausa per sviluppare e implementare congiuntamente una serie di protocolli di sicurezza condivisi per la progettazione e lo sviluppo di IA avanzate, rigorosamente controllati e supervisionati da esperti esterni indipendenti. Questi protocolli dovrebbero garantire che i sistemi che vi aderiscono siano sicuri al di là di ogni ragionevole dubbio. Ciò non significa una pausa nello sviluppo dell’IA in generale, ma solo un passo indietro rispetto alla pericolosa corsa verso modelli black-box sempre più grandi e imprevedibili con capacità emergenti. La ricerca e lo sviluppo dell’IA dovrebbero concentrarsi sul rendere i potenti sistemi all’avanguardia di oggi più accurati, sicuri, interpretabili, trasparenti, robusti, allineati, affidabili e leali. Parallelamente, gli sviluppatori di IA devono lavorare con i politici per accelerare drasticamente lo sviluppo di solidi sistemi di governance dell’IA. Questi dovrebbero come minimo includere: autorità di regolamentazione nuove e capaci dedicate all’IA; sorveglianza e monitoraggio di sistemi di IA altamente capaci e di grandi bacini di capacità computazionale; sistemi di provenienza e watermarking per aiutare a distinguere i modelli reali da quelli sintetici e per tracciare le fughe di notizie; un robusto ecosistema di auditing e certificazione; responsabilità per i danni causati dall’IA; solidi finanziamenti pubblici per la ricerca tecnica sulla sicurezza dell’IA; istituzioni ben finanziate per affrontare i drammatici sconvolgimenti economici e politici (soprattutto per la democrazia) che l’IA causerà. L’umanità può godere di un futuro fiorente con l’IA. Essendo riusciti a creare potenti sistemi di IA, possiamo ora goderci una estate dell’IA in cui raccogliere i frutti, progettare questi sistemi per il chiaro beneficio di tutti e dare alla società la possibilità di adattarsi. La società ha messo in pausa altre tecnologie con effetti potenzialmente catastrofici per la stessa e possiamo farlo anche in questo caso. Godiamoci una lunga estate dell’IA, non precipitiamoci impreparati in un autunno".